Naruszenie Anthropic Mythos: Nieautoryzowany dostęp do ekskluzywnego narzędzia AI ds. cyberbezpieczeństwa wywołuje poważne obawy dotyczące bezpieczeństwa przedsiębiorstw

BitcoinWorld

Naruszenie bezpieczeństwa Anthropic Mythos: Nieautoryzowany dostęp do ekskluzywnego narzędzia AI ds. cyberbezpieczeństwa wywołuje poważne obawy dotyczące bezpieczeństwa przedsiębiorstw

San Francisco, CA – 30 kwietnia 2025 r. – Według śledztwa Bloomberg, ekskluzywne narzędzie cyberbezpieczeństwa Anthropic o nazwie Mythos zostało rzekomo udostępnione nieautoryzowanej grupie za pośrednictwem środowiska zewnętrznego dostawcy. To wydarzenie budzi poważne obawy dotyczące bezpieczeństwa zaawansowanych systemów AI zaprojektowanych z myślą o ochronie przedsiębiorstw. Do naruszenia doszło pomimo starannie kontrolowanej strategii udostępniania Mythos przez Anthropic – narzędzia, które firma zaprojektowała specjalnie w celu wzmocnienia korporacyjnych zabezpieczeń.

Trwa dochodzenie w sprawie naruszenia bezpieczeństwa Anthropic Mythos

Anthropic potwierdziło, że prowadzi dochodzenie w sprawie doniesień o nieautoryzowanym dostępie do Claude Mythos Preview. Firma przekazała następujące oświadczenie dla Bitcoin World: „Prowadzimy dochodzenie w sprawie raportu informującego o nieautoryzowanym dostępie do Claude Mythos Preview przez jedno ze środowisk naszych zewnętrznych dostawców." Co istotne, wewnętrzne dochodzenie Anthropic nie wykazało żadnych dowodów na to, że nieautoryzowana aktywność wpłynęła na podstawowe systemy firmy. Naruszenie wydaje się ograniczone do środowiska podglądu, do którego uzyskano dostęp za pośrednictwem kanałów dostawców.

Nieautoryzowana grupa rzekomo uzyskała dostęp w tym samym dniu, w którym Anthropic publicznie ogłosiło Mythos. Zastosowała wiele strategii, aby przeniknąć do systemu. Według źródeł Bloomberg, grupa zgadywała lokalizację modelu w sieci na podstawie znajomości wzorców formatowania Anthropic stosowanych przy innych modelach. Działania grupy ujawniają potencjalne luki w protokołach bezpieczeństwa podmiotów zewnętrznych.

Ujawnione luki w zabezpieczeniach zewnętrznych dostawców

Ścieżka naruszenia obejmowała zewnętrznego wykonawcę współpracującego z Anthropic. Bloomberg poinformował, że nieautoryzowana grupa wykorzystała „dostęp" przysługujący osobie aktualnie zatrudnionej u tego wykonawcy. Incydent ten podkreśla trwałe wyzwania bezpieczeństwa związane z rozbudowanymi ekosystemami przedsiębiorstw. Zewnętrzni dostawcy często stanowią najsłabsze ogniwo w łańcuchach bezpieczeństwa korporacyjnego.

Organizacje coraz bardziej polegają na wyspecjalizowanych wykonawcach w różnych obszarach działalności. Jednak ta zależność stwarza dodatkowe powierzchnie ataku. Sytuacja z Anthropic Mythos pokazuje, jak wyrafinowani aktorzy mogą wykorzystywać te relacje. Eksperci ds. bezpieczeństwa konsekwentnie ostrzegają przed ryzykiem związanym z podmiotami zewnętrznymi. Zwracają uwagę, że oceny bezpieczeństwa dostawców często nie nadążają za ewoluującymi zagrożeniami.

| Data | Zdarzenie |

|---|---|

| Kwiecień 2025 | Anthropic ogłasza narzędzie cyberbezpieczeństwa Mythos |

| Ten sam dzień | Nieautoryzowana grupa rzekomo uzyskuje dostęp |

| 30 kwietnia | Bloomberg publikuje wyniki śledztwa |

| W toku | Anthropic przeprowadza wewnętrzny przegląd bezpieczeństwa |

Implikacje dla bezpieczeństwa AI w przedsiębiorstwach

Naruszenie bezpieczeństwa Mythos niesie ze sobą istotne konsekwencje dla bezpieczeństwa AI w przedsiębiorstwach. Anthropic zaprojektowało Mythos specjalnie w celu wzmocnienia korporacyjnych zabezpieczeń cybernetycznych. Firma przyznała podczas ogłoszenia narzędzia, że posiada ono potencjał podwójnego zastosowania. W niepowołanych rękach Mythos mógłby teoretycznie zostać użyty jako broń przeciwko systemom, które miał chronić.

Incydent ten rodzi kluczowe pytania dotyczące bezpiecznego wdrażania AI. Organizacje korporacyjne muszą wziąć pod uwagę kilka czynników:

- Protokoły kontroli dostępu: Sposób, w jaki organizacje zarządzają uprawnieniami do zaawansowanych narzędzi AI

- Zarządzanie ryzykiem dostawców: Oceny bezpieczeństwa zewnętrznych wykonawców

- Możliwości monitorowania: Wykrywanie nieautoryzowanego korzystania z systemów AI

- Reagowanie na incydenty: Procedury dotyczące potencjalnych naruszeń bezpieczeństwa AI

Motywacje i działania nieautoryzowanej grupy

Raport Bloomberg dostarcza intrygujących szczegółów na temat nieautoryzowanej grupy. Jej członkowie należą do kanału na Discordzie skupionego na odkrywaniu informacji o jeszcze nieudostępnionych modelach AI. Źródło grupy poinformowało Bloomberg, że są „zainteresowani zabawą z nowymi modelami, a nie sianiem w nich chaosu." To rozróżnienie ma znaczenie dla oceny potencjalnych ryzyk.

Grupa rzekomo regularnie korzysta z Mythos od czasu uzyskania dostępu. Dostarczyła Bloomberg dowodów, w tym zrzutów ekranu i demonstracji oprogramowania na żywo. Ich działania wydają się skupione na eksploracji, a nie złośliwym wykorzystaniu. Jednak specjaliści ds. bezpieczeństwa ostrzegają, że nawet nieautoryzowany dostęp bez złośliwych intencji stwarza ryzyko. Wyznacza ścieżki, które złośliwi aktorzy mogą później wykorzystać.

Eksperci ds. cyberbezpieczeństwa podkreślają, że intencje mogą się szybko zmienić. Grupa początkowo zainteresowana eksploracją może później zdecydować się na wykorzystanie dostępu w innych celach. Alternatywnie, ich metody dostępu mogą zostać odkryte i powielone przez naprawdę złośliwych aktorów. Krajobraz bezpieczeństwa cyfrowego nieustannie ewoluuje.

Project Glasswing i strategia kontrolowanego udostępniania

Anthropic udostępniło Mythos w ramach inicjatywy zwanej Project Glasswing. Program ten zapewnił ograniczony dostęp wybranym dostawcom, w tym dużym firmom technologicznym, takim jak Apple. Strategia kontrolowanego udostępniania miała na celu zapobieganie korzystaniu przez złośliwych aktorów. Anthropic od początku zdawało sobie sprawę z potencjału narzędzia do niewłaściwego użycia.

Project Glasswing reprezentuje rosnący trend odpowiedzialnego wdrażania AI. Firmy coraz częściej wdrażają fazowe wydania zaawansowanych systemów AI. Takie podejście pozwala na:

- Testowanie w rzeczywistych warunkach w kontrolowanych środowiskach

- Identyfikację potencjalnych luk w zabezpieczeniach

- Stopniowe skalowanie oparte na danych dotyczących wydajności i bezpieczeństwa

- Ustanowienie protokołów użytkowania i najlepszych praktyk

Mimo tych środków ostrożności, zgłoszone naruszenie pokazuje trudności związane z całkowitym zabezpieczeniem zaawansowanych systemów AI. Nawet ograniczone udostępnianie zaufanym partnerom stwarza potencjalne punkty ekspozycji. Incydent ten prawdopodobnie wpłynie na przyszłe strategie udostępniania AI w całej branży.

Reakcja branży i najlepsze praktyki bezpieczeństwa

Społeczność ds. cyberbezpieczeństwa uważnie obserwuje sytuację związaną z Anthropic Mythos. Eksperci branżowi zauważają, że naruszenia bezpieczeństwa AI wymagają specjalistycznych protokołów reagowania. Tradycyjne procedury reagowania na naruszenia danych mogą nie być wystarczające do rozwiązania ryzyk specyficznych dla AI. Obejmują one wyodrębnianie modeli, ataki wstrzyknięcia promptów i zatruwanie danych treningowych.

Zespoły ds. bezpieczeństwa w przedsiębiorstwach powinny po tym incydencie przejrzeć kilka obszarów:

Oceny bezpieczeństwa dostawców: Organizacje muszą wdrożyć rygorystyczną weryfikację wszystkich zewnętrznych dostawców mających dostęp do systemów AI. Oceny te powinny wykraczać poza standardowe kwestionariusze bezpieczeństwa. Muszą obejmować szczegółową ocenę kompetencji i protokołów bezpieczeństwa AI.

Monitorowanie dostępu: Niezbędne staje się ciągłe monitorowanie wzorców korzystania z systemów AI. Systemy wykrywania anomalii powinny oznaczać nietypowe wzorce dostępu lub wolumeny użytkowania. Systemy te muszą uwzględniać unikalne cechy interakcji z narzędziami AI.

Planowanie reagowania na incydenty: Zespoły ds. bezpieczeństwa potrzebują planów reagowania na incydenty specyficznych dla AI. Plany te powinny uwzględniać scenariusze takie jak kompromitacja modelu, nieautoryzowany dostęp i potencjalne uzbrojenie. Regularne ćwiczenia stołowe pomagają organizacjom przygotować się na rzeczywiste incydenty.

Szersze implikacje dla krajobrazu bezpieczeństwa AI

Zgłoszone naruszenie Mythos następuje w obliczu rosnących obaw dotyczących bezpieczeństwa AI. W miarę jak systemy AI stają się coraz potężniejsze i coraz bardziej zintegrowane z infrastrukturą krytyczną, ich bezpieczeństwo nabiera coraz większego znaczenia. W krajobrazie bezpieczeństwa AI pojawia się kilka trendów:

Po pierwsze, specjalistyczne role w zakresie bezpieczeństwa AI stają się coraz bardziej powszechne. Organizacje zatrudniają teraz specjalistów skupionych konkretnie na zabezpieczaniu systemów AI. Role te wymagają znajomości zarówno tradycyjnego cyberbezpieczeństwa, jak i unikalnych podatności AI.

Po drugie, wzrasta zainteresowanie regulacyjne. Rządy na całym świecie opracowują ramy dla bezpieczeństwa i ochrony AI. Incydenty takie jak naruszenie Mythos prawdopodobnie wpłyną na te regulacyjne działania. Demonstrują one rzeczywiste zagrożenia, które regulacje muszą uwzględniać.

Po trzecie, społeczność badaczy bezpieczeństwa rozszerza swoje zainteresowanie na AI. Coraz więcej badaczy analizuje specyficzne dla AI wektory ataków i mechanizmy obronne. Ten rosnący zasób wiedzy pomoże z czasem poprawić bezpieczeństwo AI.

Podsumowanie

Zgłoszony nieautoryzowany dostęp do narzędzia cyberbezpieczeństwa Mythos firmy Anthropic uwydatnia kluczowe wyzwania związane z bezpieczeństwem AI w przedsiębiorstwach. Choć dochodzenie Anthropic nie wykazało wpływu na jej podstawowe systemy, incydent ujawnia luki w protokołach bezpieczeństwa zewnętrznych dostawców. Naruszenie pokazuje, że nawet starannie kontrolowane wydania AI mogą napotkać wyzwania bezpieczeństwa. W miarę jak systemy AI stają się coraz bardziej zintegrowane z operacjami przedsiębiorstw, solidne środki bezpieczeństwa stają się coraz bardziej niezbędne. Sytuacja z Anthropic Mythos stanowi ważne studium przypadku dla organizacji wdrażających zaawansowane narzędzia AI. Podkreśla potrzebę kompleksowych strategii bezpieczeństwa obejmujących zarówno systemy wewnętrzne, jak i rozszerzone sieci dostawców.

FAQ

P1: Czym jest narzędzie cyberbezpieczeństwa Mythos firmy Anthropic?

Mythos to zasilane przez AI narzędzie cyberbezpieczeństwa opracowane przez Anthropic na potrzeby aplikacji bezpieczeństwa dla przedsiębiorstw. Narzędzie zostało zaprojektowane w celu wzmocnienia korporacyjnych zabezpieczeń, jednak posiada potencjalne możliwości podwójnego zastosowania, które mogą być wykorzystane przez złośliwych aktorów.

P2: Jak nieautoryzowana grupa uzyskała dostęp do Mythos?

Grupa rzekomo uzyskała dostęp za pośrednictwem środowiska zewnętrznego dostawcy. Zastosowała wiele strategii, w tym zgadywanie lokalizacji modelu w sieci na podstawie wzorców formatowania Anthropic stosowanych przy innych modelach.

P3: Czy Anthropic potwierdziło naruszenie?

Anthropic potwierdziło, że prowadzi dochodzenie w sprawie doniesień o nieautoryzowanym dostępie, ale stwierdziło, że dochodzenie nie wykazało żadnych dowodów na to, że aktywność wpłynęła na podstawowe systemy firmy. Dochodzenie koncentruje się na środowisku podglądu, do którego uzyskano dostęp za pośrednictwem kanałów dostawców.

P4: Czym jest Project Glasswing?

Project Glasswing to inicjatywa Anthropic dotycząca kontrolowanego udostępniania narzędzia Mythos. Zapewnia ograniczony dostęp wybranym dostawcom, w tym dużym firmom technologicznym, z celem zapobiegania nadużyciom przez złośliwych aktorów.

P5: Jakie są szersze implikacje dla bezpieczeństwa AI?

Incydent ten uwydatnia luki w zabezpieczeniach zewnętrznych dostawców oraz wyzwania związane z zabezpieczaniem zaawansowanych systemów AI. Prawdopodobnie wpłynie on na strategie udostępniania AI, działania regulacyjne oraz praktyki bezpieczeństwa przedsiębiorstw w całej branży.

Ten wpis Naruszenie bezpieczeństwa Anthropic Mythos: Nieautoryzowany dostęp do ekskluzywnego narzędzia AI ds. cyberbezpieczeństwa wywołuje poważne obawy dotyczące bezpieczeństwa przedsiębiorstw pojawił się po raz pierwszy na BitcoinWorld.

Możesz także polubić

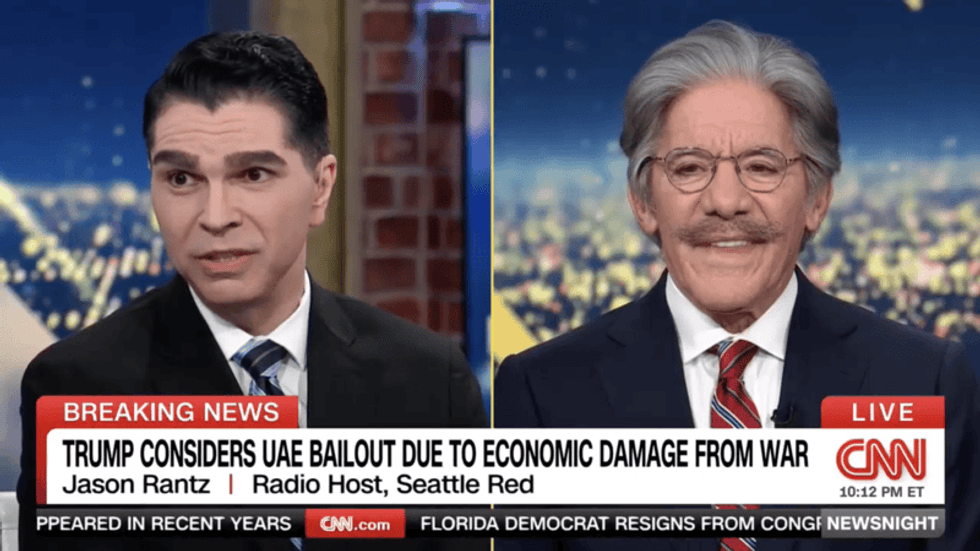

„O, daj spokój!" Geraldo Rivera miażdży obronę pomysłu Trumpa na bailout przez republikańskiego komentatora w CNN

X debiutuje z niestandardowymi osiami czasu opartymi na Grok dla tematycznych kanałów niszowych