32

Мільйони людей формують емоційні зв’язки з чат-ботами на базі штучного інтелекту — проблема, до якої політикам слід поставитися серйозно, стверджують провідні вМільйони людей формують емоційні зв’язки з чат-ботами на базі штучного інтелекту — проблема, до якої політикам слід поставитися серйозно, стверджують провідні в

Чат-боти зі штучним інтелектом: про що попереджають експерти

4 хв читання

Чат-боти зі штучним інтелектом: про що попереджають експерти

Сьогодні 17:45 — Фінтех і Картки

Мільйони людей формують емоційні зв'язки з чат-ботами

Мільйони людей формують емоційні зв’язки з чат-ботами на базі штучного інтелекту — проблема, до якої політикам слід поставитися серйозно, стверджують провідні вчені.

Попередження про зростання кількості ботів зі штучним інтелектом, призначених для розвитку стосунків з користувачами, міститься в оцінці, опублікованій у вівторок, щодо прогресу та ризиків штучного інтелекту, пише politico.

Про що йдется

«Популярність штучного інтелекту швидко зростає, деякі програми охоплюють десятки мільйонів користувачів», — згідно з оцінкою десятків експертів, переважно науковців, проведеною вдруге в рамках глобальної ініціативи, започаткованої світовими лідерами у 2023 році.

Спеціалізовані сервіси-компаньйони, такі як Replika та Character. ai, мають десятки мільйонів користувачів, причому користувачі називають різні причини, включаючи розвагу та цікавість, а також бажання полегшити самотність, йдеться у звіті.

Але люди також можуть шукати товариства за допомогою універсальних інструментів, таких як ChatGPT від OpenAI, Gemini від Google або Claude від Anthropic.

«Навіть звичайні чат-боти можуть стати компаньйонами», — сказав Йошуа Бенджіо, професор Монреальського університету та провідний автор Міжнародного звіту про безпеку штучного інтелекту. Бенджіо вважається одним із провідних світових експертів зі штучного інтелекту. «У правильному контексті та за достатньої кількості взаємодій між користувачем та штучним інтелектом можуть розвинутися стосунки», — сказав він.

Вплив

Хоча в оцінці визнається, що докази щодо психологічного впливу компаньйонів неоднозначні, «деякі дослідження повідомляють про такі закономірності, як посилення самотності та зниження соціальної взаємодії серед тих, хто часто вживає наркотики», йдеться у звіті.

Це попередження з’явилося через два тижні після того, як десятки законодавців Європейського парламенту звернулися до Європейської комісії з вимогою розглянути можливість обмеження супутніх послуг згідно із законом ЄС про штучний інтелект через побоювання щодо їхнього впливу на психічне здоров’я.

«Я бачу в політичних колах, що вплив цих штучних інтелектів-компаньйонів на дітей, особливо підлітків, викликає багато здивування та уваги», — сказав Бенджіо.

Ці побоювання підживлюються підлабузницькою природою чат-ботів, які прагнуть бути корисними для своїх користувачів і максимально їм догодити.

«Штучний інтелект намагається змусити нас у даний момент почуватися добре, але це не завжди в наших інтересах», — сказав Бенджіо. У цьому сенсі технологія має схожі підводні камені з платформами соціальних мереж, стверджував він.

Бенджіо сказав, що очікує введення нових правил для вирішення цього явища.

Однак він виступив проти ідеї запровадження спеціальних правил для супутників зі штучним інтелектом і стверджував, що цей ризик слід вирішувати за допомогою горизонтального законодавства, яке одночасно враховує кілька ризиків.

Безпека

Міжнародний звіт про безпеку штучного інтелекту опубліковано напередодні глобального саміту, який розпочнеться 16 лютого, щорічної зустрічі країн для обговорення управління технологіями, що цього року проводиться в Індії.

У звіті перераховано повний перелік ризиків, які політикам доведеться враховувати, включаючи кібератаки за допомогою штучного інтелекту, згенеровані штучним інтелектом діпфейки сексуального характеру та системи штучного інтелекту, що надають інформацію про те, як розробляти біологічну зброю.

Експерт закликав уряди та Європейську комісію покращити свою внутрішню експертизу в галузі штучного інтелекту для вирішення довгого переліку потенційних ризиків.

Тетяна Берегова

Кореспондент-редактор

За матеріалами: Finance.ua

# Фінтех

Місце для вашої реклами

Якщо Ви помітили помилку, виділіть необхідний текст і натисніть Ctrl+Enter , щоб повідомити про це.

Поділитися новиною

Також за темою

-

Чат-боти зі штучним інтелектом: про що попереджають експертиУ 2025 році кількість ідентифікацій через BankID НБУ зросла на 25% у порівнянні з 2024 (інфографіка)Перекази коштів в Україну скорочуються другий рік поспільРоботи почали вивчати нові навички за допомогою додатківНБУ закликав банки посилити фінмоніторинг і обмін інформацією про ризикових клієнтівMicrosoft представила власний чіп для прискорення ШІ — деталі (фото)

Підпишіться на нас

- Finance.ua

- /

- Всі новини

- /

- Фінтех і Картки

- /

- Чат-боти зі штучним інтелектом: про що попереджають експерти

Відмова від відповідальності: статті, опубліковані на цьому сайті, взяті з відкритих джерел і надаються виключно для інформаційних цілей. Вони не обов'язково відображають погляди MEXC. Всі права залишаються за авторами оригінальних статей. Якщо ви вважаєте, що будь-який контент порушує права третіх осіб, будь ласка, зверніться за адресою [email protected] для його видалення. MEXC не дає жодних гарантій щодо точності, повноти або своєчасності вмісту і не несе відповідальності за будь-які дії, вчинені на основі наданої інформації. Вміст не є фінансовою, юридичною або іншою професійною порадою і не повинен розглядатися як рекомендація або схвалення з боку MEXC.

Вам також може сподобатися

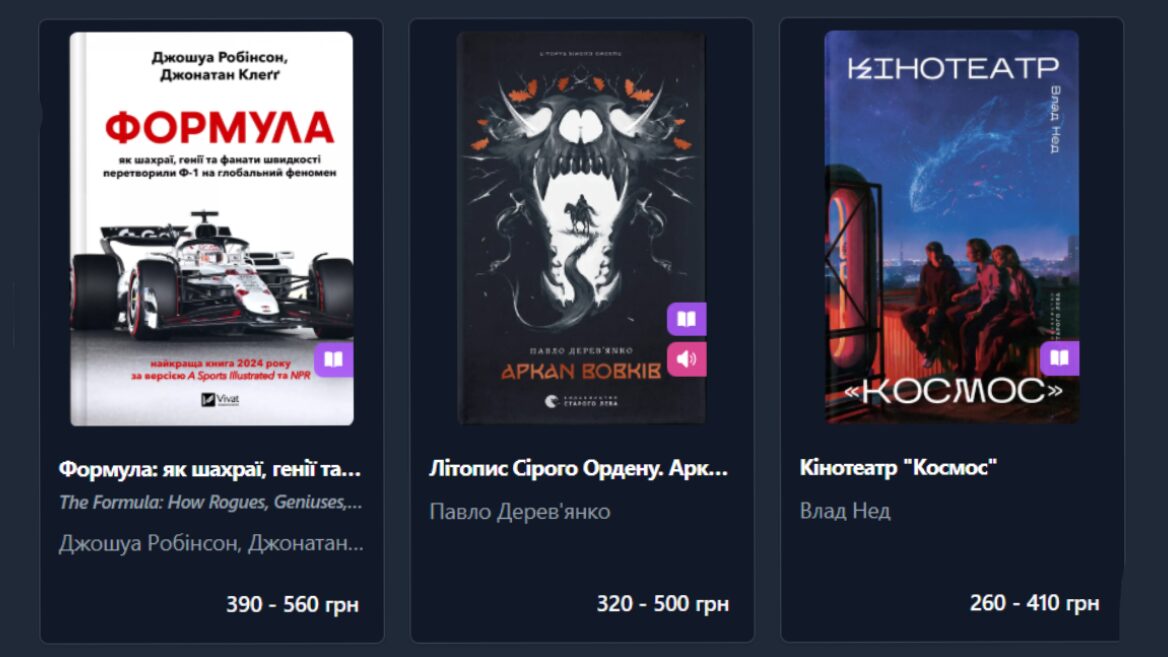

Український айтівець створив сервіс порівняння цін на книги Kebuk

Айтівець Тарас Ковалів розповів про свій агрегатор українських книжкових крамниць Kebuk, який дозволяє користувачам порівнювати ціни на книги. Сервіс також має

Поділитись

Dev2026/02/04 00:02

У Харкові через удари рф зливають воду з системи опалення у 820 будинках — мер

У Харкові через масовану комбіновану атаку росії ухвалили рішення про злив води із системи опалення у 820 житлових будинках, щоб не допустити замерзання теплови

Поділитись

Finance2026/02/04 00:30

Wizz Air продає дешеві квитки: термін та рейси

Бюджетний перевізник Румунії Wizz Air та Міжнародний аеропорт Клуж-Напока оголошують сьогодні про 2 нові напрямки на літній сезон 2026 року.

Поділитись

Finance2026/02/04 00:10