الخطر الحقيقي للذكاء الاصطناعي في الاختبار: الثقة الزائفة، وليس الأخطاء

أضاءت لوحة المعلومات باللون الأخضر. نجحت جميع الاختبارات الدخانية. قام وكيل الذكاء الاصطناعي بإنشاء حالات اختبار جديدة، وإزالة القديمة، بل وأبلغ في غضون دقائق كيف تحسنت تغطية الاختبار. انتقل الفريق نحو الإطلاق بثقة يوم الجمعة.

الآن، إنه صباح الاثنين.

هناك تذاكر في الدعم. العملاء الذين لم يتمكنوا من إتمام الشراء بعناوينهم المحفوظة. كيف تعطلت عناوينهم المحفوظة؟ تبدو واجهة المستخدم معطلة تمامًا على جهاز محمول نموذجي. لم يكن لدى واجهة برمجة تطبيقات حرجة معالجة قوية للحالات الحدية. عند أخذها معًا، تشير كل هذه المشكلات إلى تهديد أكبر: استعداد الفريق للاعتماد بشكل أعمى على المدخلات الخارجية، بافتراض أن كل شيء صحيح.

هذا هو الخطر الحقيقي الذي يجلبه الذكاء الاصطناعي إلى ضمان الجودة.

ليس الأمر أن الذكاء الاصطناعي سيدخل أخطاء إلى اختباراتنا. جميع البرامج بها أخطاء. جميع فرق ضمان الجودة جيدة في تحديدها وحلها. ومع ذلك، فإن التهديد الأكبر للذكاء الاصطناعي هو أنه يمكن أن يجعل الفريق يعتقد أن اختباراتهم شاملة حتى عندما لا تكون كذلك. مع الذكاء الاصطناعي في الاختبار، يمكن لفريق ضمان الجودة الحصول على شعور زائف بالراحة بأن كل شيء دقيق.

يمكن أن تكون هذه الثقة الزائفة باهظة الثمن للغاية. يمكن أن يؤدي هذا الثقة المفرطة إلى التزامات مالية ضخمة. حتى أنظمة الذكاء الاصطناعي التي تم اختبارها بالكامل يمكن أن تفشل في بعض الأحيان عند مواجهة تعقيدات العالم الحقيقي. ماكدونالدز أغلقت مؤخرًا نظام ذكاء اصطناعي من IBM كانت تختبره في عدادات الطلب من السيارة بعد أن ارتكب أخطاء متكررة في الطلبات. إنه تذكير بأن حتى التقنيات الموثوقة يمكن أن تحتوي على عيوب خطيرة.

ماذا تعني الثقة الزائفة في ضمان الجودة حقًا

تحدث المشكلة الحقيقية عندما يقتنع الفريق بأن الاختبارات قد اختبرت النظام المعطى بشكل كافٍ. ينبع هذا الشعور الزائف بالأمان من حقيقة أن مخاطر الأمان ذات الصلة إما لم يتم اكتشافها أو لم يتم اختبارها بدقة.

كانت هذه مشكلة منذ فترة طويلة في طرق الأتمتة التقليدية. في هذه الطرق، قد يتم تشغيل عدد كبير من الاختبارات، ولكن ليس هناك الكثير من العمق في الاختبار. حقيقة أن تقرير خط الأنابيب يقول إن جميع الفحوصات قد نجحت (كلها خضراء) لا يعني أن النظام نفسه سيكون بالضرورة يعمل بشكل مثالي.

تصبح الأتمتة أكثر تعقيدًا عند تنفيذ الذكاء الاصطناعي. شيء واحد يجب معرفته حول نماذج لغة الذكاء الاصطناعي هو أنها يمكن أن تقدم المعلومات بطريقة تبدو مقنعة ولكنها في الواقع مضللة.

قد نرى الاختبارات تعمل وحتى تغطية اختبار أفضل، حيث يساعد الذكاء الاصطناعي في بناء الاختبار وتحليل نتائج أي تشغيل للاختبار. كل هذا مفيد.

ولكن ليست كل الفوائد موثوقة تمامًا.

قد يفوت الاختبار الذي يبنيه الذكاء الاصطناعي بعض القطع الحرجة من منطق الأعمال. بدلاً من ذلك، قد يتم تصميمه فقط لاختبار السيناريوهات الشائعة. سيبدو مثل هذا الاختبار مناسبًا تمامًا. إذا كانت النتائج نظيفة ومعبر عنها بوضوح، فمن المحتمل أن يعتبر الفريق الاختبار مناسبًا، مما يترك العيوب الخطيرة غير مكتشفة.

لهذا السبب يمكن للاختبارات في كثير من الأحيان أن تخلق فرصًا للفرق لوضع افتراضات خاطئة.

السؤال الأكثر أهمية اليوم، لأي شخص يشارك في اختبارات البرمجيات التلقائية باستخدام الذكاء الاصطناعي، يجب ألا يكون "هل يبني الذكاء الاصطناعي الاختبارات بكفاءة أكبر؟" ولكن، يجب أن يكون "هل الاختبارات التي بناها الذكاء الاصطناعي موثوقة حقًا؟"

لماذا يجعل الذكاء الاصطناعي المشكلة أصعب للملاحظة

يمكن تحديد الاختبار اليدوي السيئ بسرعة. غالبًا ما ترتكب الاختبارات المكتوبة بشكل غير صحيح أخطاء.

ولكن عندما تفشل الاختبارات المبنية بواسطة الذكاء الاصطناعي، يصعب معرفة ذلك من النظرة الأولى. قد يقدمون تأكيدات تبدو دقيقة جدًا، وأسماء وسيناريوهات تبدو واقعية. لكنهم قد يتجاهلون بصمت أهم العوامل. قد يسيئون تفسير الغرض الحقيقي من الميزة. قد يقدمون نفس الأفكار بشكل مختلف. يمكن للذكاء الاصطناعي أيضًا إصدار تقارير مفرطة الثقة حول إصدار البرنامج دون أدلة كافية.

يخلق هذا فجوة خطيرة بين السلاسة التي تظهر من الخارج والجودة التي في الداخل.

في ضمان الجودة، يجب أن تأتي ثقتنا من إمكانية تتبع الاختبارات، وعمق التغطية، وتقييم المخاطر، والنتائج الملاحظة. وليس من مدى جمال البيانات التي ينتجها الذكاء الاصطناعي للنظر إليها.

مبرمج يستخدم الكمبيوتر في المنزل للذكاء الاصطناعي. Freepikالحوسبة محاكاة الدماغ البشري من خلال خوارزميات التعلم الذاتي. موظف يعمل مع شبكات عصبية عميقة للذكاء الاصطناعي على كمبيوتر سطح المكتب، كاميرا A

مبرمج يستخدم الكمبيوتر في المنزل للذكاء الاصطناعي. Freepikالحوسبة محاكاة الدماغ البشري من خلال خوارزميات التعلم الذاتي. موظف يعمل مع شبكات عصبية عميقة للذكاء الاصطناعي على كمبيوتر سطح المكتب، كاميرا A

خمس طرق يخلق بها الذكاء الاصطناعي ثقة زائفة في ضمان الجودة الحديث

الإفراط في اختبار السيناريوهات الشائعة

يتفوق الذكاء الاصطناعي حيث توجد أنماط منتظمة. لذلك، فهو ينجذب بسهولة إلى التدفقات العادية، والمدخلات المتوقعة، وسلوك المستخدم الشائع.

لكن العيوب البرمجية الخطيرة غالبًا ما تختبئ في أماكن أخرى:

- انتقالات الحالة: أثناء التغييرات من حالة إلى أخرى.

- مشكلات التوقيت: أخطاء في توقيت العمليات.

- إعادة المحاولة والانقطاعات: مشاكل عندما يتم إعادة محاولة المعاملات الفاشلة أو مقاطعتها.

- حدود الأذونات: ثغرات أمنية في حدود الأذونات.

- الفشل الجزئي: عندما تفشل أجزاء فقط من النظام دون تعطل كامل.

- مدخلات العالم الحقيقي غير المتسقة: معلومات عشوائية يقدمها العملاء في العالم الحقيقي.

إذا اتبعت الاختبارات المولدة بالذكاء الاصطناعي فقط السيناريوهات الشائعة التي تصورها مصمم المنتج، فإنها ستترك المسارات الخطرة دون لمس. وهذا يخدم فقط لخلق وهم أن الاختبارات كاملة.

ينشئ تأكيدات ضعيفة

القيمة الحقيقية للاختبار هي ما يثبته حول البرنامج. الكثير من الاختبارات الرهيبة تغطي نطاقًا ضخمًا من الإجراءات على التطبيق، لكنها لا تتحقق بشكل صحيح مما إذا كانت هذه الإجراءات تنجح للأعمال. الاختبار هو مجرد حركة حيث كل ما يفعله هو النقر على الأزرار، وملء الحقول، والنقر على المزيد من الأزرار، وعرض الشاشات، ورؤية شيء ما ينبثق.

يمكن للذكاء الاصطناعي تنفيذ مثل هذه الاختبارات التلقائية الخفيفة بشكل أسرع بكثير من الإنسان. ومع ذلك، إذا كانت شروط الاختبار الخاصة بك (التأكيدات) عامة جدًا، أو محددة بشكل سيئ، أو غير ذات صلة بحالة الاستخدام التجاري، فإن مجرد تنفيذ نجاح الاختبار لا يوفر الكثير من الأمان لإصدار البرنامج. قد يُظهر نجاح الاختبار في عملية الدفع مجرد لافتة نجاح ولا يضمن معالجة الطلب بشكل صحيح (الضريبة، الإجماليات، إلخ)، أو إرسال بريد إلكتروني، أو تقليل المخزون.

المزيد من حالات الاختبار والمزيد من العيوب

قد يتحقق الفريق من 40 حالة اختبار مكتوبة باليد. لكنهم قد لا يتخذون نفس النهج مع 400 تم إنشاؤها بسرعة باستخدام الذكاء الاصطناعي. هذا واحد من أكبر مخاطر ضمان الجودة القائمة على الذكاء الاصطناعي: ينخفض الاختبار الدقيق بشكل طبيعي مع زيادة العدد.

يمكن أن يمنحنا وجود المزيد من حالات الاختبار نوعًا من الثقة النفسية. عندما يزداد العدد، نشعر أن مجموعة الاختبار واسعة جدًا والتقارير خالية من العيوب. لكن زيادة عدد حالات الاختبار ليست بديلاً أبدًا عن جودتها.

بدون تعيين المخاطر المناسب وإمكانية تتبع المتطلبات، سيساعد الذكاء الاصطناعي فقط في تسجيل التخمينات بدلاً من التحقق من الجودة الحقيقية للنظام.

يخلق ثقة عمياء في الأضواء الخضراء

عندما تُظهر تقارير خط الأنابيب دائمًا اللون الأخضر، فإنها تمنح الفرق إحساسًا قويًا بالثقة وتشجع على اتخاذ قرارات سريعة. إنها تزيل العقبات عن إنجاز العمل، لذلك ينتشر هذا الشعور بالأمان بسهولة حيث تبدأ الفرق في بناء وإصلاح وترتيب أولويات اختباراتها الخاصة باستخدام الذكاء الاصطناعي. يتحول غريزتهم من التحقق والتحقق من النتائج إلى مجرد الثقة في النظام بشكل أعمى. على السطح، يبدو الأمر بسيطًا، ولكن يمكن أن يغير ثقافة ضمان الجودة إلى الأبد. يتوقف السؤال عن كونه "ما المخاطر التي يغطيها هذا الاختبار؟" ويصبح "هل أجرى الذكاء الاصطناعي اختبارًا لهذا؟" في هذه المرحلة، يميل الناس إلى افتراض أن كل شيء على ما يرام والتوقف عن التشكيك في الجودة.

يجعل حتى الأخطاء العمياء تبدو ذكية

واحدة من أخطر ميزات أنظمة الذكاء الاصطناعي الحديثة هي أنها يمكن أن تقدم حتى أكثر الأخطاء وضوحًا بمصداقية كبيرة. هذا له أهمية كبيرة في ضمان الجودة.

حتى إذا كُتب اختبار الذكاء الاصطناعي بسوء فهم لمتطلب أو معلومات غير كاملة، فإن مخرجاته ستكون دقيقة جدًا ومصقولة لتبدو وكأنها كُتبت بشكل صحيح. لن يتمكن الاختبار النموذجي من العثور بسرعة على الخطأ. الخطر هنا ليس فقط في الخطأ نفسه، ولكن أيضًا في مدى سهولة جعل الخطأ يصدق.

قد يتم إصلاح خطأ واضح بسرعة. لكن الاستنتاج الخاطئ الذي يبدو قابلاً للتصديق من المحتمل أن يتم إصداره دون اختبار.

ما تفعله فرق ضمان الجودة الذكية بشكل مختلف

هذا لا يعني أنه يجب تجنب الذكاء الاصطناعي تمامًا.

الحل هو استخدامه دون التخلي عن حكمك للذكاء الاصطناعي. ترى أفضل فرق ضمان الجودة الذكاء الاصطناعي كمساعد، وليس شيئًا يجب الوثوق به بشكل أعمى. بينما يستخدمونه لزيادة السرعة، فإنهم لا يمنحونه الثقة النهائية. أي أنهم يتبعون أسلوب عمل حيث يثقون فقط في المخرجات المقدمة من الذكاء الاصطناعي بعد التحقق منها.

دعونا نرى كيف يعمل ذلك في الممارسة.

فهم المخاطر قبل بناء الاختبارات

قبل إنشاء حالات الاختبار، يجب عليك تحديد المشاكل الرئيسية التي يمكن أن تؤثر على العمل أو المستخدم بوضوح.

المجالات المتعلقة بالمعاملات المالية، والمسائل القانونية (الامتثال)، والهوية، والأذونات، وثقة العملاء يجب أن تكون أول من يولي الاهتمام. ما هي الأخطاء التي تحدث نادرًا جدًا ولكنها تسبب الكثير من الخسارة؟ أين تذهب الأخطاء دون أن يلاحظها أحد بسهولة؟

يمكن للذكاء الاصطناعي تقديم أفكار جديدة في مثل هذه المجالات. لكن الأمر متروك للبشر لتحديد أين توجد المزيد من المخاطر.

تحقق مما يؤكده الاختبار، وليس فقط الخطوات

قد تبدو كل خطوة في حالة اختبار مولدة بالذكاء الاصطناعي صحيحة للوهلة الأولى. لكن السؤال الحقيقي هو ما إذا كان الاختبار يختبر فعلاً النتيجة الصحيحة.

من الجيد تطوير عادة بسيطة عند الاختبار: ركز أكثر على ما يثبته الاختبار بدلاً من كيفية عمله.

الحفاظ على تغطية الاختبار متعددة الطبقات

لا يمكن لطبقة واحدة من الاختبار وحدها أن تضمن اكتمال النظام. اختبار الوحدة، وواجهة برمجة تطبيقات، والتكامل، والاختبار من البداية إلى النهاية (E2E)، والاختبار الاستكشافي، وملاحظات الإنتاج كلها تكشف أنواعًا مختلفة من المخاطر.

إذا كان الذكاء الاصطناعي يختبر طبقة واحدة فقط، فلا يجب على الفرق اعتبار أن نظامهم آمن تمامًا. يجب اختبار كل طبقة بأهميتها الخاصة.

مستقبل ضمان الجودة ليس أقل بشرية

يخشى الكثيرون أن يصبح الذكاء الاصطناعي في الاختبار مسعى بلا بشر. لكن في الواقع، يحدث العكس.

مع تولي الذكاء الاصطناعي المهام المتكررة، يصبح التدخل البشري أكثر قيمة. تحديد المخاطر، وإزالة الغموض، والتشكيك في الافتراضات، واختبار الحالات الحدية المعقدة، وطرح السؤال "هل النظام آمن لأن الاختبار نجح؟" كل هذا يتطلب ذكاءً بشريًا.

هذا لا يتعلق بعمل أقل، بل بجودة أفضل. أفضل فرق المستقبل ليست تلك التي تبني عددًا لا يحصى من الاختبارات. إنها تلك التي يمكنها العمل بسرعة وبعناية، ولكن التشكيك عند الضرورة.

لأن الأخطاء في الأنظمة دائمًا مرئية. لكن الثقة المفرطة غالبًا ما تقودنا إلى تجاهلها.

دروس لخطوتك التالية

يمكن للذكاء الاصطناعي بالتأكيد تسريع عمليات ضمان الجودة. يمكنه مساعدة الفرق في بناء الاختبارات، وتقليل المهام المتكررة، والاستجابة للتغييرات بسرعة أكبر.

لكن هذه السرعة غير الخاضعة للإشراف يمكن أن تؤدي إلى نوع جديد من مشكلة الجودة. عندما تجعلنا الاختبارات المولدة بالذكاء الاصطناعي نشعر بالاكتمال، عندما تجعلنا لوحات المعلومات اللامعة نؤمن بها، عندما تأخذ التقارير الفاخرة الأسبقية على التقييمات الدقيقة، فإن ضمان الجودة ليس قويًا حقًا. بدلاً من ذلك، يصبح من السهل خداعه.

الفرق الأكثر أمانًا هي تلك التي تتذكر الحقيقة البسيطة أنه فقط لأن الاختبار ينجح، فهو ليس دليلاً مطلقًا على أن النظام آمن. إنه مجرد مؤشر، ولا يزال يتعين استخدام الذكاء البشري لتقييم هذا المؤشر.

لذا، فإن التهديد الحقيقي الذي يشكله الذكاء الاصطناعي على ضمان الجودة ليس الأخطاء. بل الثقة الزائفة التي يمنحها.

قد يعجبك أيضاً

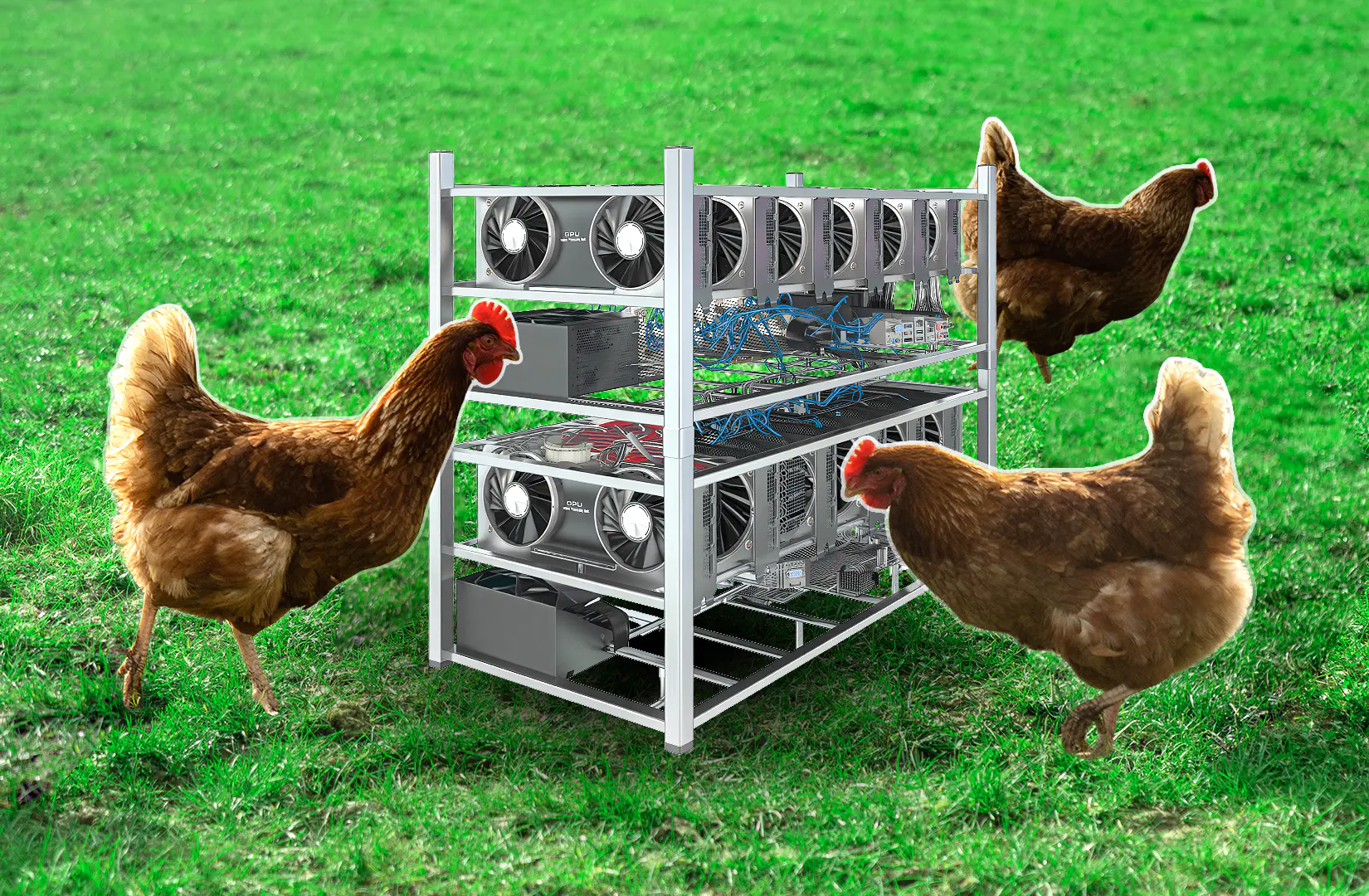

المحققون يعثرون على العشرات من مزارع تعدين الكريبتو متنكرة في شكل حظائر دجاج

متداول ذكي يبدأ في البيع على المكشوف للإيثريوم والبيتكوين بعد تحقيق ربح بقيمة 34 مليون دولار